Big-Data-Analytics zählt zu den großen Revolutionen der digitalen Transformation. Indem Sie riesige Datenbestände auf Muster untersuchen, erhalten Sie beispielsweise wichtige Consumer-Insights oder optimieren Produktionsprozesse. Erfahren Sie hier, wie Big-Data-Analytics funktioniert, was weitere Anwendungsgebiete sind und welche Technologien zum Einsatz kommen.

Die ahd ist seit 2021 Teil der Proact Gruppe.

Unsere neuesten Blogbeiträge findest du ab sofort auf dem Proact Blog.

Klick dich rein und bleib up to date!

Inhalt dieses Blogbeitrags

- Was ist Big Data?

- Was ist Big-Data-Analytics?

- Die Geschichte von Big-Data-Analytics

- Diese Herausforderungen existieren

- Von diesen Vorteilen profitieren Sie

- Welche Anwendungsgebiete es gibt

- Diese Technologien und Tools kommen zum Einsatz

- Vier Tipps für Ihr Big-Data-Projekt

- Schaffen Sie Ihre Big-Data-Umgebung mit der ahd!

Schön, dass Sie hier sind! Wie Ihnen vielleicht schon aufgefallen ist, verwenden wir aus Gründen der Lesbarkeit die männliche Form in unseren Texten. Im Sinne der Gleichbehandlung meinen wir damit selbstverständlich immer alle Geschlechter (m/w/d). Und jetzt wünschen wir Ihnen viel Spaß beim Lesen.

Was ist Big Data?

Websites, Webshops, Onlinemarketing, Social Media, Internet of Things – alle diese Medien generieren riesige Mengen Daten und das in hohem Tempo und mit einer enormen Datentypen-Vielfalt. Dies fordert die IT in einem völlig neuen Ausmaß. Der Begriff Big Data bezeichnet daher Datenbestände, welche die Möglichkeiten und Grenzen der konventionellen IT übersteigen.

Die Herausforderungen von Big Data lassen sich mit den folgenden vier „Vs“ beschreiben:

| Volume: | Riesige Datenvolumina im Bereich von Hunderten Terabytes, je nach Unternehmen sogar bis zu mehreren Exabytes (1 Mio. Terabyte). |

| Velocity: | Große Datenströme, die oftmals in Echtzeit in die Speicher fließen und zunehmend auch in Echtzeit ausgewertet werden müssen. |

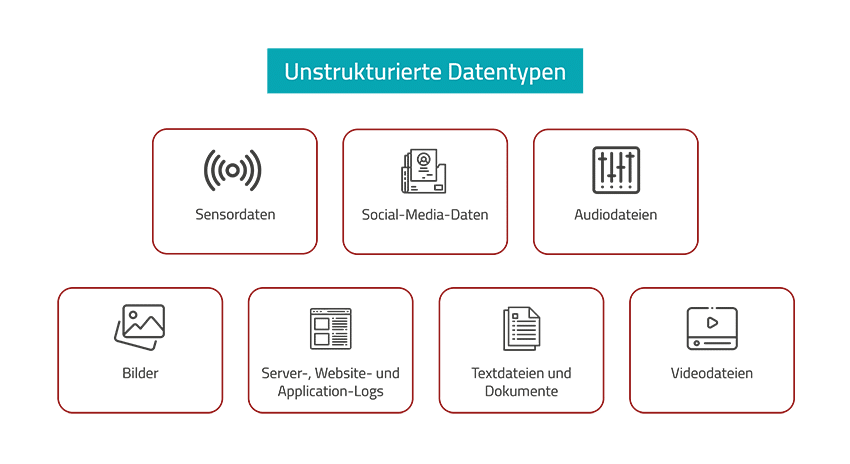

| Variety: | Eine wachsende Vielfalt an Datentypen. Insbesondere nehmen die unstrukturierten Datentypen zu, wie sie in Texten, Audiofiles, Videos oder Sensordaten vorkommen. |

| Veracity: | Veracity („Wahrhaftigkeit“) bezeichnet das Problem der inhaltlichen Verlässlichkeit von Big-Data-Informationen: Sind die aus der Datenflut abgeleiteten Informationen wahrheitsgetreu? |

Was ist Big-Data-Analytics?

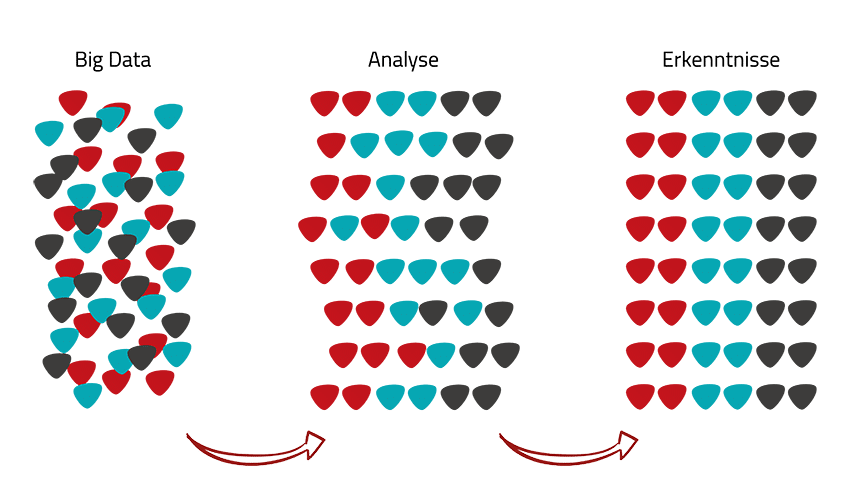

Big-Data-Analytics ist der Oberbegriff für das Auswerten großer, dynamischer, vielfältiger Datenmengen (Big Data). Diese Tätigkeit umfasst drei Kernaufgaben, welche aufeinander aufbauen:

- Datenbeschaffung

- Datenaufbereitung

- Datenauswertung

Diese drei Aufgaben der Big-Data-Analytics werden im Folgenden genauer erklärt.

Datenbeschaffung

Aufgrund der hohen Anzahl unterschiedlicher Datenquellen aus denen Big-Data-Analytics schöpft, ist bereits die Datenbeschaffung eine große Herausforderung. Die wichtigsten Probleme sind:

- Bewertung der Datenquelle anhand der vier Basiskriterien der Informationsqualität: Aktualität, Vollständigkeit, Korrektheit und Relevanz. Basierend auf den Erkenntnissen dieser Voranalyse ist zu entscheiden, ob, wie, wozu und in welchem Umfang eine Datenquelle genutzt werden soll.

- Erschließung der Datenquelle; das heißt Abruf und Speicherung der Daten. Es gilt, eine effiziente und sichere Input-Pipeline einzurichten. Meistens befindet sich diese in einer Cloud und nutzt besondere Speichermodelle wie Data-Lakes.

- Datenformat für den Export bzw. die Speicherung. Ideal sind Datenformate, mit welchen Data-Scientists häufig arbeiten, zum Beispiel CSV, JSON oder XML.

- Update-Zyklen. Manche Informationen verlieren ihre Aktualität bereits nach wenigen Stunden oder Tagen. Entsprechend hoch muss der Datenabruf getaktet werden. Dies wiederum hat Konsequenzen für die Konstruktion der Input-Pipeline.

Datenaufbereitung

Die wenigsten Daten sind bereits im Rohzustand für die Analyse geeignet. Häufig müssen sie bereinigt werden, damit die Analyse sinnvolle und richtige Resultate ergibt:

Fehlende Werte („Missing Data“) müssen identifiziert und codiert werden. Diesen Schritt setzen die meisten Analysetools zwingend voraus.

Ausreißer („Outlier“), also Extremwerte weitab vom Mittelwert, sollten ausgefiltert werden, weil sie die Analyse-Ergebnisse verzerren würden.

Durch Störungen in der Datenquelle oder andere Probleme können sich Fehler im Datensatz einschleichen. Diese bewirken Inkonsistenzen im Datensatz oder führen zu unplausiblen Resultaten. In der Datenaufbereitung sind diese Fehler aufzuspüren und zu beseitigen.

Schließlich sollten die Daten durch Filterung auf diejenigen Bereiche eingegrenzt werden, die für die Analyse relevant sind. Dieser Schritt ist wichtig, damit die Auswertungssoftware effizient arbeiten kann.

Datenauswertung

Die gesammelten und aufbereiteten Daten werden nun mit Analysesoftware ausgewertet. Die wichtigsten Analysen sind:

| Data-Mining: | Mittels Verfahren der analytischen Statistik wie Regressions- oder Clusteranalyse versucht man, verborgene Zusammenhänge im Datenbestand zu erkennen. |

| Predictive Analytics: | Besondere statistische Analysemodelle erlauben es, in begrenztem Rahmen quantitative Vorhersagen abzuleiten. |

| Machine-Learning: | Anhand großer Datensätze lernt die Software, bestimmte Muster selbstständig zu erkennen und zu kategorisieren. Typische Beispiele sind Bewegungsmuster, Bilder, Videos oder Texte. |

| Text-Mining: | Analyse von Texten zu unterschiedlichen Zwecken: Auswertung von Kundenrezensionen, automatische Textzusammenfassungen, Wortanalysen usw. |

| Business-Intelligence: | Statistische Auswertungen von Geschäftskennzahlen, oftmals in Form von Dashboards dargestellt. |

Neben den erwähnten Analysen gibt es noch viele weitere, die weniger bekannt sind. Im Zusammenhang mit Automatisierung und künstlicher Intelligenz (KI) kommen laufend neue Verfahren hinzu.

Die Geschichte von Big-Data-Analytics

Der Begriff „Big Data“ entstand Mitte der 1990er-Jahre. Er bezeichnete große Datenmengen, welche eine zunehmende Herausforderung für die IT darstellten.

Im Jahr 2001 wurde der Begriff durch Doug Laney, damals Analyst bei Meta Group Inc., erweitert: Nicht nur die Datenmenge (Volume) ist ein Merkmal von Big Data, sondern auch die Vielfalt (Variety) der Datenstrukturen und die Geschwindigkeit (Velocity) des Datenflusses sind in die Definition einzuschließen.

Die drei Faktoren Volume, Variety und Velocity wurden als „die drei Vs“ von Big Data bekannt. Später kam als zusätzlicher Aspekt die unsichere Wahrhaftigkeit (Veracity) hinzu.

Ein weiterer Meilenstein in der Geschichte von Big Data war die Einführung von Hadoop, einem Framework für die verteilte Datenverarbeitung. Hadoop wurde 2006 von Apache als Open-Source-Projekt veröffentlicht. Die Bedeutung von Hadoop liegt darin, dass Big-Data-Analysen mit Standard-Hardware möglich sind: Mehrere Computer werden durch Hadoop zu einem Cluster verbunden, sodass die Rechenlast auf sie verteilt wird.

Es dauerte rund fünf Jahre, bis Hadoop und verwandte Big-Data-Technologien sich in den Unternehmen etablierten. Seit circa 2011 wird Big Data auf breiter Basis genutzt. Die Pioniere waren die großen Internet- und E-Commerce-Unternehmen wie Google, Facebook und Amazon sowie die Analyse- und Marketingdienstleister.

Heute ist Big-Data-Analytics in vielen Branchen fester Bestandteil der Geschäftsprozesse, so zum Beispiel bei Banken, Versicherern, Produktherstellern, Einzelhändlern, Gesundheitsorganisationen oder Energiekonzernen.

Diese Herausforderungen existieren

Auch wenn Software und Cloud-Technologien den Umgang mit Big Data erleichtern, ist die Nutzung nach wie vor mit Herausforderungen verbunden. So sind die in unstrukturierter Form gespeicherten Daten weniger leicht zugänglich als etwa Informationen in SQL-Datenbanken. Die Extraktion von Informationen aus Data-Lakes verlangt oftmals Expertenwissen.

Wenn Daten aus unterschiedlichsten Quellen stammen, ist das Beurteilen der Datenqualität schwierig. Hier stellen sich Fragen wie: Stimmen die Daten überhaupt? Woher stammen sie eigentlich? Welche Informationen sind aktuell, welche veraltet?

Nicht zu unterschätzen sind die Probleme des Datenschutzes, wie sie sich seit Einführung der DSGVO in wachsendem Ausmaß stellen. Denn in der heutigen Big-Data-Welt fließen die Informationen quer über verschiedene Kontinente, Server, Cloud-Anwendungen und Analysten-Notebooks. Es wird immer komplizierter, den Schutz vertraulicher Daten durchgängig sicherzustellen.

Big-Data-Analytics erfordert eine hohe Rechenleistung. Die verwendete Software muss viele Suchabfragen effizient durchführen, große Datenmengen blitzschnell importieren und in hohem Tempo verarbeiten. Parallele Bearbeitungsverfahren sind dazu unerlässlich. Zwar existieren quelloffene Software-Frameworks, welche die Verarbeitung riesiger Informationsmengen mithilfe vernetzter Clustersysteme ermöglichen – eine Herausforderung bleibt die Performance von Big-Data-Analysen trotzdem.

Auch die Relevanz der Analysen stellt ein Problem dar: Oft startet die Datenanalyse explorativ, das heißt ohne genaues Ziel. Wenn durch Data-Mining interessante Beziehungen zwischen Daten gefunden werden, bedeutet dies aber noch nicht zwangsläufig, dass diese Information auch relevant ist. Die Frage, wozu Big-Data-Analytics dient, stellt sich deshalb in vielen Führungsetagen nach wie vor. Einige mögliche Antworten darauf lesen Sie nachfolgend.

Von diesen Vorteilen profitieren Sie

Die Nutzung von Big-Data-Analytics ist nur dann sinnvoll, wenn sie auf den Unternehmenserfolg einzahlt. Worin liegen die Vorteile konkret? Hier die häufigsten Antworten auf diese Frage:

Komplexität meistern

Konventionelle Business-Intelligence-Ansätze sind für einfache Datensätze gedacht. Die Auswertung erfolgt mittels beschreibender Statistik und der Analyse vorwiegend linearer Zusammenhänge. Ziel ist es, Geschäftskennzahlen abzuleiten. Die digitalisierte Welt ist aber oft zu kompliziert für diese Art der Analyse. Big-Data-Analytics meistert Komplexität besser, denn sie erschließt auch nichtlineare Optimierungspotenziale.

Automatisierung von Geschäftsprozessen

Mittels Machine-Learning können Geschäftsprozesse intelligenter gestaltet und stärker automatisiert werden. Das spart Kosten.

Beschleunigte Produktentwicklung

Dank detaillierter Daten über die Produkte und deren Nutzung können Unternehmen in viel kürzeren Zyklen Optimierungen vornehmen und Innovationen zur Marktreife bringen.

Optimierung von Einkauf und Lagerhaltung

Wenn Unternehmen ihre Warenflüsse konsequent digital erfassen und mittels Big-Data-Analytics auswerten, können sie die benötigten Lager- und Transportkapazitäten exakter steuern und Kosten einsparen.

Mehr Sicherheit dank Frühwarnsystemen

Big-Data-Analytics eignet sich dazu, auf Basis von künstlicher Intelligenz Frühwarnsysteme zu konstruieren, welche drohende Störungen und Ausfälle schon lange im Voraus erkennen können.

Stärkere Kundenbindung

Wird Big-Data-Analytics für die personalisierte Ansprache und für individualisierte Dienstleistungen benutzt, so kann das Unternehmen damit die Kundenbindung steigern und den Kundenwert erhöhen.

Schnellere Informationen

Dank der Geschwindigkeit moderner Systeme für Big-Data-Analytics können Unternehmen ihre Geschäftsdaten praktisch in Echtzeit umfassend analysieren. Dies ermöglicht es, bessere Entscheidungen schneller zu treffen.

Welche Anwendungsgebiete es gibt

Big-Data-Analytics umfasst eine fast unüberschaubare Anzahl von Anwendungsgebieten. Hier einige besonders typische Beispiele:

Consumer-Insights

Mit Big-Data-Analytics können Unternehmen eine 360-Grad-Ansicht auf das Verhalten und die Motivation ihrer Kundinnen und Kunden gewinnen. Dazu sammeln sie unter anderem Informationen aus:

- Onlinekäufen

- Surfverhalten

- Reaktionen auf Marketingaktivitäten

- Social-Media-Beiträgen

- Rezensionen

- direkten Kundenkontakten via Chat, Telefon und E-Mail

- aus Umfragen

- App-Daten

Hieraus leiten die Unternehmen Einblicke (Consumer-Insights) ab, die sie für verbesserte Produkte, Innovationen und zahlreiche Marketingmaßnahmen nutzen.

Onlinemarketing

Das Onlinemarketing definiert anhand von Big-Data-Analytics Kundensegmente, Zielgruppen („Targeting“) und Werbebotschaften („Messaging“). Auf der Website können basierend auf Datenanalysen auch individuell auf den jeweiligen Besucher angepasste Inhalte angezeigt werden („Behaviour Based Offering“).

Personalisierte Plakatwerbung

Spannende Anwendungsmöglichkeiten ergeben sich auch im Bereich „Digital-Out-of-Home“ (DOOH): Versteckte Sensoren an den digitalen Plakaten erfassen in Echtzeit die Menschen, welche davor stehen. Der Algorithmus entscheidet, welche Werbung für diese Menschen angezeigt wird.

Betrugsdelikte identifizieren und bekämpfen

Eines der besten und frühesten Beispiele für Big-Data-Analytics ist die Betrugsbekämpfung der Kreditkartenfirmen: Diese sammeln über einen längeren Zeitraum viele Daten über die Nutzung einer Kreditkarte. Daraus errechnet der Algorithmus ein kundenindividuelles „Normalnutzungsmuster“. Wenn nun untypische Ausgaben registriert werden, die nicht zu diesem Muster passen, schlägt der Computer Alarm und das Callcenter der Kreditkartengesellschaft meldet sich beim Kunden, um den Fall abzuklären.

Prozessanalysen

Heute können Prozesse jeglicher Art mittels Kameras, Logfiles und Sensoren lückenlos erfasst werden. Auf diese Weise ist es möglich, den Ablauf genauestens zu analysieren und Ineffizienzen aufzuspüren. Big-Data-Analytics erarbeitet also Einblicke, wo Kosten und Zeit gespart werden könnten. Ebenso kann eine Firma die Qualität ihrer Produkte verbessern und die Ausschussmenge verringern.

Künstliche Intelligenz

Mit Machine-Learning kann man einem Computer beibringen, bestimmte „intelligente“ Tätigkeiten auszuüben. So übernehmen zum Beispiel kollaborative Roboter Fertigungsaufgaben Seite an Seite mit menschlichen Arbeitskräften. Und in immer mehr Lagerhallen kommen Palettier- und Transportroboter zum Einsatz.

Preisoptimierung

Wenn genau bekannt ist, zu welchem Zeitpunkt die Kundschaft einen bestimmten Preis akzeptiert, kann ein Anbieter mittels dynamischer Preisgestaltung seinen Umsatz maximieren.

Diese Technologien und Tools kommen zum Einsatz

Big-Data-Analytics schöpft aus einer Vielzahl von technologischen Hilfsmitteln und Konzepten. Einige der wichtigsten davon sind:

Hadoop

Hadoop ist ein Open-Source-Framework für das Speichern und Verarbeiten großer Datenmengen. Es wurde von Google basierend auf dem Map-Reduce-Algorithmus entwickelt, um rechenintensive Prozesse bis zu mehreren Petabytes zu bewältigen. Dies gelingt vor allem dadurch, dass die Datenmenge auf mehreren Computer verteilt bearbeitet wird (Parallelisierung).

Speichermodelle

Big Data hat neue Speichermodelle hervorgebracht, welche das konventionelle Data-Warehouse um Lösungen für unstrukturierte Daten ergänzen:

- Data-Lakes („Datenseen“) nehmen jegliche Art von Daten auf, ohne ein Dateiformat oder eine Ablagestruktur vorzuschreiben. Das Ordnen, Strukturieren, Bereinigen und Filtern der Daten erfolgt erst beim Abruf (Datenextraktion).

- No-SQL-Datenbanken sind nichtrelational und können deshalb auch unstrukturierte Rohdaten aufnehmen. Zudem eignen sie sich gut für die Arbeit mit großen Mengen verteilter Daten.

- Distributed-Storage-Systeme replizieren Daten auf mehreren Speichern, in der Regel nichtrelationale Datenbanken. Dies dient einerseits dem schnelleren Zugriff (Parallelisierung) und schützt andererseits auch vor Ausfällen, wenn einzelne Knoten im Big-Data-Cluster beschädigt sind.

Stream-Analytics-Tools

Immer häufiger werden kontinuierlich fließende Datenströme ausgewertet, unter anderem Wetterdaten oder Informationen von Sensoren. Bekannte Tools für das Auswerten von kontinuierlichen Datenströmen sind Spark Streaming, Apache Flink und Apache Storm.

Datenaufbereitungssoftware

Bei der Datenaufbereitungssoftware unterscheidet man zwischen diesen Unterkategorien:

- Datenvorbearbeitungssoftware dient dazu, Daten zu formatieren und zu bereinigen.

- Datenqualitätssoftware hat die Aufgabe, die Integrität der Daten zu prüfen und diese von Elementen zu befreien, welche die Analyse beeinträchtigen könnten: Ausreißer, unplausible Informationen, veraltete Daten und Ähnliches.

- Datenvirtualisierung ermöglicht einen Datenzugriff ohne technische Einschränkungen.

- Datenintegrationssoftware dient dazu, Big Data über diverse Plattformen hinweg zu rationalisieren.

In-Memory-Analyse

Würde die Analysesoftware ihre Daten von der Harddisk lesen oder sogar übers Internet beziehen, wäre die Auswertung sehr langsam. Deshalb laden die neueren Tools den Datensatz vollständig in den schnellen Arbeitsspeicher (RAM) des Computers. Wenn die Datenmenge die Kapazität eines Rechners übersteigt, kommt die In-Memory-Data-Fabric zum Zuge, welche das RAM mehrerer Rechner zu einem Cluster zusammenschließt.

Data-Mining

Data-Mining-Software dient dem Ziel, Muster in den Daten zu erkennen: verborgene Beziehungen, wiederkehrende Patterns, vom Auge nicht feststellbare Abweichungen und andere wertvolle Informationen.

Text-Mining

Kundenrezensionen, Social-Media-Beiträge, Chat-Verläufe, E-Mails und andere Texte fallen in derart großer Menge an, dass sie nicht mehr von Menschenhand ausgewertet werden können. Um diese Textdaten nutzbar zu machen, setzen Unternehmen Text-Mining-Tools ein. Diese dienen dazu, Textinhalte nach Themen zu kategorisieren, zu verschlagworten, die „Stimmung“ einzuschätzen (Sentiment-Analysis) oder sogar automatisch eine Zusammenfassung des Textes zu schreiben.

Machine-Learning

Machine-Learning gilt als Königsdisziplin der Big-Data-Analytics: Anhand zahlreicher Beispiele lernt der Computer, bestimmte Daten korrekt zu interpretieren. Bekannte Anwendungen von Machine-Learning sind:

- Google Lens, welche Gegenstände, Pflanzen und andere Objekte anhand des Kamerabildes benennt.

- Amazon Alexa, welche natürlichsprachige Äußerungen des Menschen interpretiert.

- Bilddatenbanken, welche mit Machine-Learning die Bildinhalte analysieren und das Bild entsprechend verschlagworten.

- Google Suggest, welches schon während der Sucheingabe herausfindet, was der User will, und passende Suchbegriffe vorschlägt.

- Webshop-Empfehlungen, die aufgrund des typischen Kundenverhaltens feststellen, welche Produktempfehlungen für den jeweiligen User am erfolgreichsten sein werden.

Predictive-Analytics-Software

Basierend auf vorhandenen Daten berechnet Predictive-Analytics-Software die Wahrscheinlichkeit künftiger Ereignisse. Auf diese Weise ist es möglich, die voraussichtlich benötigte Warenmenge an einem bestimmten Tag zu errechnen oder den Umsatz einer neuen Produktvariante vorherzusagen.

Cloud-Plattformen

Big Data ist ohne Cloud-Plattformen undenkbar. Clouds sind notwendig, um die gigantischen Datenmengen effizient zu speichern und abzurufen. Auch die erforderliche Rechenleistung kann kaum noch kostendeckend On-Premises bereitgestellt werden. Beispielsweise wäre es nicht sinnvoll, einen Server mit einem Terabyte Arbeitsspeicher anzuschaffen, um einen einzelnen, besonders großen Datensatz zu analysieren. Deshalb bezieht man die Rechenleistung für Big-Data-Analytics häufig flexibel über einen externen Provider.

Vier Tipps für Ihr Big-Data-Projekt

Damit Ihre Big-Data-Analyse gelingt, sollten Sie die folgenden vier Best Practices berücksichtigen.

1. Starten Sie mit einem Business-Problem im Hinterkopf

Big-Data-Analytics ist sowohl personal- als auch kostenintensiv. Deshalb muss der finanzielle Nutzen des Projektes klar erkennbar sein. Finden und formulieren Sie Fragestellungen, welche aus Business-Sicht relevant sind, zum Beispiel:

- Welche Bedürfnisse wird unsere Kundschaft morgen haben?

- Wie können wir unsere Lagerhaltung reduzieren?

- Wo müssen wir unseren Webshop optimieren, um die Conversion-Rate zu erhöhen?

- Was lernen wir aus den Rezensionen und Reklamationen unserer Kundschaft?

Definieren Sie das Big-Data-Projekt von Anfang an als die Lösung eines konkreten Problems. Auf diese Weise überzeugen Sie Ihre Stakeholder und bringen das Data-Analytics-Team auf Kurs.

2. Überlegen Sie von Anfang an, wie Sie die Resultate kommunizieren

Jede gute Analyse beginnt beim Report. Nur wenn Sie sich zuerst überlegen, wem Sie in der Firma welche Erkenntnisse vermitteln müssen, können Sie zielgerichtet analysieren. Dies betrifft einerseits die verschiedenen Hierarchiestufen, andererseits die Fachbereiche, welche von Ihren Erkenntnissen profitieren sollen:

- Marketing

- Produktentwicklung

- Vertrieb

- Finanzabteilung

- Kundendienst

Stellen Sie sich die Frage: „Welche Informationen benötigen diese Menschen?“ Nicht immer sind Datencharts die Antwort! Oftmals geht es um qualitative Informationen wie Rankings, Profile, Wenn-Dann-Logiken oder Top-Ten-Listen.

3. Setzen Sie eine Vielfalt von Instrumenten ein

Die Zahl der Analytics-Tools ist in den letzten Jahren förmlich explodiert: Python, R, MATLAB, Hive, Groovy, Scala, SQL, SAS, KNIME, Orange und weitere Softwareprodukte stehen zur Verfügung – viele von ihnen als kostenlose Open-Source-Anwendungen.

Nutzen Sie diese Vielfalt! Denn für jede Aufgabe, jeden Datensatz und jeden Analyseschritt existieren jeweils besonders effiziente Programme. Zudem haben Analysten ganz unterschiedliche Arbeitsstile.

4. Finden Sie die Balance zwischen Automatisierung und Expertise

Software ersetzt keine Menschen, sondern bloß bestimmte Arbeitsschritte. Setzen Sie deshalb Softwaretools gezielt dazu ein, Ihre Data-Analysts von Routineaufgaben zu entlasten. Aber versuchen Sie nicht, die menschliche Expertise durch Algorithmen zu ersetzen! Am meisten profitieren Sie von Big-Data-Software, wenn Sie sie „kollaborativ“ verwenden: zur Unterstützung der menschlichen Expertinnen und Experten.

Schaffen Sie Ihre Big-Data-Umgebung!

Um Ihre IT auf Big-Data-Analytics vorzubereiten, benötigen Sie leistungsfähige Speicherlösungen. Hier kommen unsere Experten ins Spiel: Wir realisieren für Sie eine Vielzahl von modernen Cloud- und On-Premises-Modellen. Dabei leisten wir nicht nur die technische Umsetzung, sondern unterstützen Sie auch strategisch sowie beim Change-Management.

Kontaktieren Sie uns jetzt über unsere Muttergesellschaft Proact für eine unverbindliche Erstberatung!

Die ahd ist seit 2021 Teil der Proact Gruppe.

Unsere neuesten Blogbeiträge findest du ab sofort auf dem Proact Blog.

Klick dich rein und bleib up to date!